Imagina que tienes un asistente capaz de responder cualquier pregunta, proporcionar análisis científicos o ayudar a descubrir nuevos medicamentos, y que nunca duerme ni olvida: esa es la visión de OpenAI para su avanzado modelo GPT-5.2. Ahora, ¿qué te parecería si te contáramos que la estrategia de OpenAI para 2026 es moverse más allá del mero avance de la capacidad técnica hacia la implementación práctica y real en las empresas? ¿Y si además te dijéramos que están trabajando en un nuevo dispositivo de inteligencia artificial en colaboración con Jony Ive, el antiguo jefe de diseño de Apple? OpenAI es una compañía que ha sabido adaptarse a los cambiantes vientos del sector de la inteligencia artificial. Aunque una vez tuvieron la supremacía del mercado con alrededor del 50% en 2023, esa cifra cayó drásticamente a un preocupante 27% para finales de 2025. A pesar de esto, la empresa sigue teniendo un rendimiento impresionante, con más de 5 millones de usuarios empresariales que utilizan su modelo ChatGPT Enterprise. Pero este año, la empresa está realizando un cambio estratégico significativo para recuperar la participación de mercado y expandirse a nuevos sectores, todo ello bajo la dirección de Barret Zoph, quien lidera los esfuerzos de ventas para empresas. El punto de inflexión está en la nueva estrategia propuesta por la CFO Sarah Friar, que dirige a OpenAI hacia lo que llama “adopción práctica”. No sólo están ampliando su capacidad de cómputo a gran escala, pasando de 0.2 GW en 2023 a un increíble 1.9 GW en 2025, sino que están diversificando su enfoque comercial más allá de las suscripciones, hacia modelos basados en el uso de API’s, precios basados en los resultados e incluso licencias de propiedad intelectual. Todo esto tiene como objetivo convertir a OpenAI en “una capa operativa para el trabajo de conocimiento”, algo similar a tener ese asistente infatigable que mencionamos al principio, disponible para todo tipo de trabajo intelectual. Los pasos que OpenAI está tomando ya están dando frutos, como es evidente en su reciente colaboración con ServiceNow. Esta asociación multi-anual permite a los clientes de ServiceNow acceder a los modelos de OpenAI, lo que abre una nueva serie de aplicaciones prácticas y útiles. Los esfuerzos de OpenAI están dirigidos principalmente a los sectores de la salud, la ciencia y la empresa. Para ilustrar aún más, imagina que diriges una farmacia que se dedica a la investigación de nuevos medicamentos. Ahora, en lugar de depender solo de tu equipo de investigación, puedes utilizar el modelo GPT-5.2 de OpenAI para analizar rápidamente miles de informes de investigación, detectar patrones y proporcionar análisis predictivos. Estas implementaciones prácticas de la IA son las que pueden cambiar radicalmente la forma en que las empresas operan. El objetivo de OpenAI va más allá de convertirse en una capa de trabajo de conocimiento para empresas. Están invirtiendo fuertemente en el desarrollo de dispositivos de inteligencia artificial con el antiguo director de diseño de Apple, Jony Ive. Ima Glass ha insinuado que este dispositivo será una experiencia más “serena” que un smartphone, quizás un dispositivo portátil como los auriculares “Sweetpea” o la pequeña “Gumdrop”. Si bien los detalles exactos aún son confidenciales, la anticipación es alta para el lanzamiento previsto a finales de 2026. El célebre poeta Robert Frost escribió una vez: “Dos caminos divergieron en un bosque y yo, yo tomé el menos transitado, y eso ha marcado toda la diferencia”. OpenAI parece estar tomando su propio camino menos transitado, alejándose del puro desarrollo de capacidades hacia la integración empresarial y la exploración de hardware. Si bien la ruta parece desafiante, con una competencia feroz y grandes requisitos de capital, el potencial de un viaje exitoso es enorme. ¿Podrá OpenAI ser el socio tecnológico fundamental para las empresas e instituciones de todo el mundo y cambiar la forma en que hacemos negocios, como Robert Frost cambió la poesía? Sólo el tiempo lo dirá.

¿Cómo los copilotos de AI están cambiando la forma de codificar?

Piénsalo por un momento: ¿qué pasaría si tuvieras un asistente de desarrollo de software que no solo estuviera allí para ayudarte a generar fragmentos de código, sino que funcionara como un colaborador estratégico? Uno que anticipa tus necesidades como desarrollador y te ayuda en la toma de decisiones. No es una idea futurista. Es el amanecer de la era del copiloto de AI en la codificación. Los desarrollos recientes han permitido que el año 2026 sea testigo del avance significativo de la codificación asistida por AI. De ser simplemente una herramienta de conveniencia para una codificación más rápida, la AI ha evolucionado para convertirse en un socio estratégico de desarrollo que está remodelando la manera en que los desarrolladores piensan, planean, y construyen software. Este cambio es uno de los más significativos en la industria del software con cerca del 84% de los desarrolladores utilizando o planeando utilizar herramientas de codificación de AI, un considerable aumento en comparación con el 76% del año anterior. Ahora, en lugar de responder simplemente a los comandos de los desarrolladores, los sistemas de AI anticipan las necesidades de los desarrolladores, sugieren mejoras y ayudan en la toma de decisiones. Herramientas como Copilot de GitHub, que fue diseñada para ayudar a los desarrolladores a razonar a través de soluciones en lugar de generar códigos a ciegas, marcando una evolución importante en la forma en que los desarrolladores interactúan con los sistemas de AI. Los sistemas de codificación de AI ahora comprenden bases de código completas, historias de proyectos y patrones de desarrollo en vez de solo líneas aisladas de código. Este entendimiento constante y a nivel de proyecto significa que los desarrolladores ya no necesitan establecer repetidamente el contexto. La adopción de la AI en la codificación también ha llevado a la evolución de la comunicación, pasando de simples comandos escritos a la interacción multimodal donde los desarrolladores se comunican con la AI a través de diagramas, descripciones, capturas de pantalla y registros. Este enfoque multimodal está acelerando el desarrollo y haciendo que la codificación sea más intuitiva y colaborativa, cambiando el futuro de puramente basado en texto a interacciones visuales y conversacionales. Para ilustrarlo con un ejemplo, imagina que eres dueño de una empresa tecnológica en pleno crecimiento y buscas formas de escalar tus proyectos sin comprometer su calidad. Te enfrentas a la repetición constante de contextos y a un proceso de codificación mecánico que no es eficiente ni sostenible a largo plazo. La implementación de las nuevas herramientas de codificación de AI que incluyen planes de desarrollo de proyectos, permitiría a tu equipo de desarrollo centrarse más en las necesidades estratégicas que en la generación autómata de código. Entonces, ¿qué nos depara el futuro de la codificación de AI? Vamos más allá de agregar AI a los sistemas de software existentes y nos movemos hacia la construcción de sistemas donde la AI es un componente central desde el principio. Imagina que los desarrolladores orquestaran la participación de AI en los procesos y la toma de decisiones. Un futuro en el que la calidad está garantizada con el uso de AI, llevando a cabo pruebas de presión de las aplicaciones como lo harían los testers humanos, incluso probando casos límite y validando superficies de conversión fundamentales. Un futuro en el que trabajar con máquinas inteligentes será la norma en lugar de la excepción. Pero hay una gran pregunta que surge: ¿Será un futuro en el que la AI reemplace completamente a los desarrolladores o simplemente será una herramienta que mejorará enormemente sus habilidades y capacidades? La respuesta radica en cómo elegimos manejar estos cambios y cómo adaptamos nuestros procesos y flujos de trabajo para aprovechar al máximo esta revolución digital.

¿Cómo el AGI puede cambiar la dinámica en tu empresa?

¿Podrías imaginar un colaborador en tu empresa que pueda aprender, razonar y resolver problemas en toda una gama de dominios de manera autodidacta? No, no estamos hablando de un empleado superior milagrosamente versátil. Estamos hablando de la creación y uso de sistemas de Inteligencia Artificial General technology o AGI. El campo de la Inteligencia Artificial está cambiando rápidamente. La industria tecnológica pronostica destacar el AGI como punto focal en 2026, aunque los expertos advierten que su implementación completa aún es incipiente más que inminente. A diferencia de los sistemas de AI estrechos diseñados para tareas específicas, el AGI puede adaptarse y generalizar como la mente humana. Ya hay progresos significativos, con sistemas de AI ahora capaces de trabajar en múltiples modalidades—texto, imágenes y voz—ejemplificado por modelos como GPT-4o y Gemini. Los sistemas de AGI son esencialmente como tener un asistente que nunca duerme y nunca olvida, con la capacidad además de aprender y adaptarse a una amplia gama de tareas. Esta es una gigantesca rueda de cambio en movimiento, una que abre una serie de posibilidades en múltiples sectores, desde el científico hasta el financiero, pasando por el legal y estratégico. Las expectativas de la industria para 2026 son altas. Las empresas se están moviendo hacia etapas tempranas de implementaciones de sistemas de AGI para procesos interfuncionales, marcando la transición de programas piloto de investigación a entornos de producción. Algunos logros esperados incluyen agentes autónomos en contextos científicos y de investigación que generan hipótesis y analizan datos, IA de razonamiento que respalda la toma de decisiones legales, financieras y estratégicas, y avances científicos y creativos habilitados por modelos de AI de propósito general. Imagina que diriges una compañía farmacéutica. Las implicaciones de un sistema AGI son extraordinarias. Ahora puedes tener un sistema de IA que genera hipótesis y análisis de datos sin intervención humana, optimizando los procesos de desarrollo y detección de nuevos medicamentos. Supon que eres un abogado. Un sistema AGI puede examinar las leyes existentes, los precedentes legales y los detalles del caso en cuestión para proporcionarte las estrategias legales más viables. La carrera de infraestructura para soportar el desarrollo del AGI está intensificando rápidamente. NVIDIA presentó su emblemática plataforma “Vera Rubin” de AI en el CES de 2026, diseñada específicamente para manejar modelos de trillón de parámetros requeridos para sistemas AGI avanzados. Se prevé que los proveedores de nube estadounidenses gasten $600 mil millones en infraestructura de AI en 2026 para apoyar el enorme crecimiento de la demanda de AI, sentando las bases computacionales necesarias para la investigación y la implementación de AGI. Los expertos de AI de Stanford predicen explícitamente que no habrá AGI en 2026, lo que indica que a pesar del progreso significativo y la inversión, la plena inteligencia artificial general sigue siendo un horizonte a largo plazo. El recorrido hasta la superinteligencia está en marcha, y aunque el AGI aún no ha llegado, su llegada sin duda está en el horizonte. ¿Cómo afectará este potente nuevo miembro del equipo a tu empresa y a la dinámica de trabajo en general? ¿Cuán preparados estamos para convivir, y eventualmente, colaborar con la superinteligencia? Las respuestas están en desarrollo. Mientras esperamos, es esencial entender la mecánica y las implicaciones del emergente AGI, al igual que comprender cómo aprovechar sus fortalezas y limitaciones únicas.

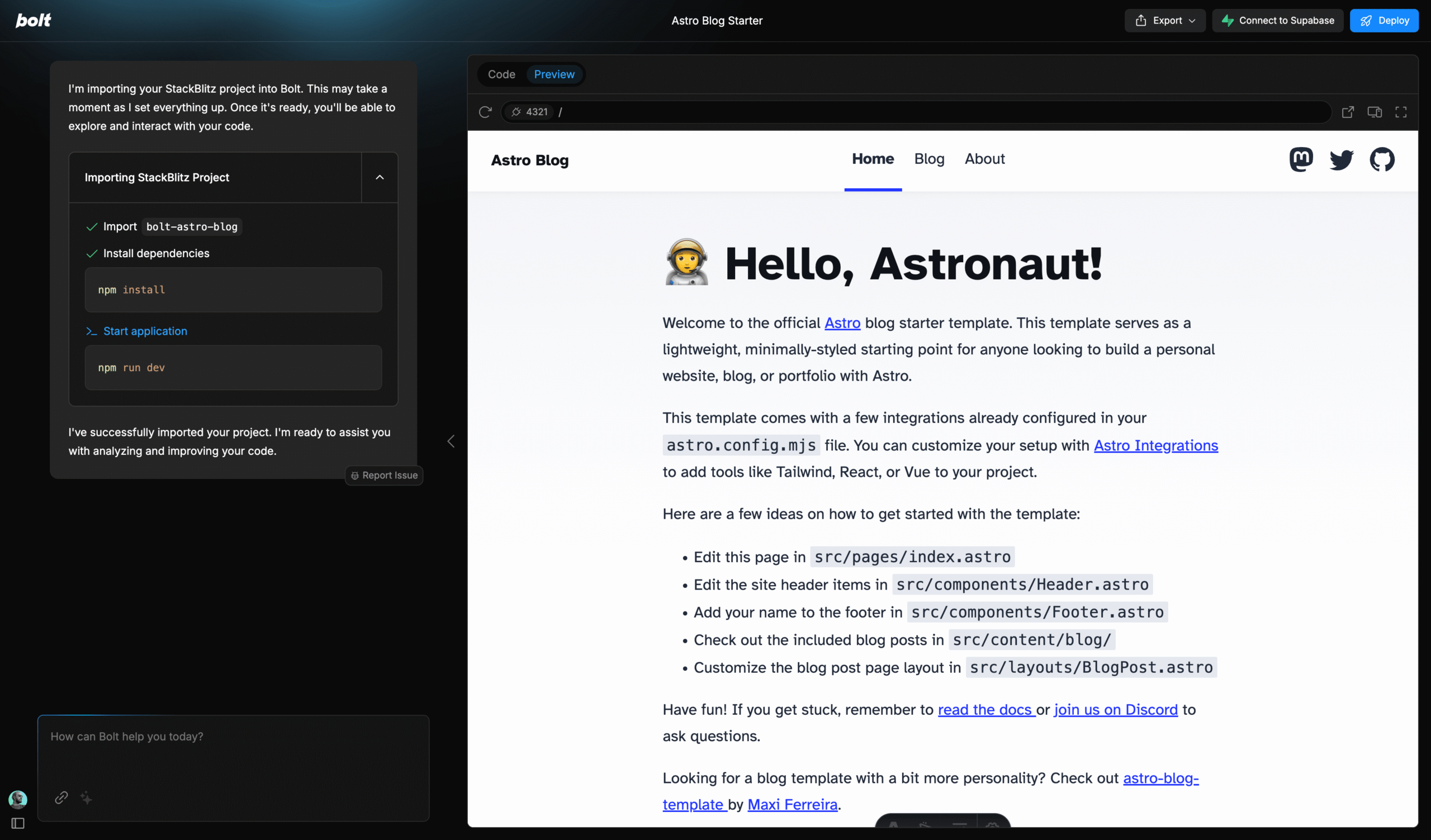

Cómo Bolt.new puede ahorrarte meses de desarrollo web

¿Imaginas poder crear una aplicación web completa en minutos sin tener que escribir ni una línea de código? ¿Cómo sería si tuviéramos una herramienta que transformara nuestras descripciones simples en inglés en códigos de aplicación funcionales en un abrir y cerrar de ojos? Pues estas no son fantasías futuristas sino las fascinantes promesas de Bolt.new. Esta plataforma es un constructor de aplicaciones web impulsado por inteligencia artificial (IA) que está cambiando fundamentalmente el ciclo de desarrollo de aplicaciones. Recientemente, Bolt.new ha mejorado su sistema de gestión de contextos, lo que le permite manejar proyectos mil veces más grandes de lo que era posible anteriormente. Esto responde a las preocupaciones de escalabilidad que han limitado históricamente las plataformas de código mínimo y sin código. Echemos un vistazo más profundo a lo que la hace especial. Bolt.new utiliza modelos de lenguaje avanzados, principalmente Claude de Anthropic, para convertir las descripciones en inglés en código de aplicación funcional. ¿Qué significa esto exactamente? Es como tener un traductor muy eficiente que puede interpretar tus ideas y traducirlas a un lenguaje que las computadoras entienden perfectamente. Y no solo eso, Bolt.new está equipado con una serie de características técnicas que cubren todo el espectro de desarrollo de aplicaciones. Estas características incluyen la generación de andamios de pila completa (frontend, backend y capas de base de datos simultáneamente), integraciones incorporadas para eliminar horas de configuración manual del backend, diseño optimizado para entornos de escritorio, tableta y móviles, y pruebas y previsualizaciones en tiempo real, a través de las cuales los desarrolladores pueden iterar instantáneamente dentro del entorno del navegador. Además, los usuarios pueden descargar el código fuente a GitHub o desplegar directamente a través de la integración con Netlify con un solo clic. Imagina que eres un emprendedor y tienes una idea brillante para una aplicación web. Sin embargo, no tienes el conocimiento de codificación necesario ni el dinero suficiente para contratar a un equipo de desarrolladores. En el pasado, esto podría haber sido un obstáculo insuperable para ti. Pero con Bolt.new, solo necesitas describir tu idea y ver cómo cobra vida en minutos. O supongamos que trabajas en una agencia de marketing y tus clientes necesitan una serie de páginas de aterrizaje para una próxima campaña. En lugar de gastar dias codificando, puedes aprovechar Bolt.new para construir rápidamente estas páginas y centrarte en los aspectos de diseño y contenido. Bolt.new también está siendo utilizado por desarrolladores profesionales para prototipos rápidos, permitiendo que las empresas de todos los tamaños validen sus ideas de productos más rápidamente al eliminar la sobrecarga de configuración. Además, permite la creación de herramientas internas para empresas, desde paneles y sistemas de aprobación hasta portales de clientes. Mirando hacia el futuro, Bolt.new ejemplifica una tendencia más amplia que está reformando el desarrollo de software: las plataformas de desarrollo mejoradas con IA que comprimen los plazos de desarrollo al tiempo que reducen las barreras técnicas de entrada. Al permitir que los no desarrolladores construyan aplicaciones funcionales y permitir a los desarrolladores experimentados saltarse las tareas de configuración repetitivas, Bolt.new está desafiando los flujos de trabajo tradicionales de desarrollo de pila completa. La combinación de interfaces visuales sin código con la generación de código impulsada por IA posiciona a Bolt.new en la intersección de dos grandes tendencias tecnológicas: la maduración de los grandes modelos de lenguaje para la generación de código y la evolución continua de las plataformas de bajo código/sin código en herramientas viables para producción. ¿Es este el futuro del desarrollo de software? Solo el tiempo lo dirá. Pero una cosa es cierta: Bolt.new está llevando el potencial de la inteligencia artificial a un público más amplio, allanando el camino para una nueva era de creación web.

Lo que nadie te cuenta sobre los sistemas RAG empresariales

La toma de decisiones basada en un sinfín de estadísticas es cosa del pasado. ¿Por qué? Porque ahora contamos con una tecnología revolucionaria como la Retrieval-Augmented Generation (RAG) que, en lugar de recopilar un torbellino de datos, recibe, procesa y devuelve información precisa y contextualizada de acuerdo a las necesidades específicas de las empresas. En el 2026, más del 60% de las implementaciones de IA empresarial se basan en RAG u otras técnicas de generación similar. Este ascenso meteórico ha cambiado fundamentalmente la forma en que las organizaciones construyen sistemas de inteligencia artificial. Este salto viene a raíz de un avance importante en el campo de la inteligencia artificial. La tecnología RAG resuelve una limitación clave de los grandes modelos de lenguaje tradicionales: su dependencia de los datos de entrenamiento estáticos. Al integrar mecanismos de recuperación con capacidades de generación, RAG permite que los sistemas de IA accedan a información actual de fuentes externas como bases de datos, documentos, entre otros antes de generar respuestas. Tenlo en cuenta como si tuvieras una biblioteca virtual a tu disposición que, en lugar de leer todo el material de una, pudiera seleccionar la respuesta perfecta a tu consulta en tiempo real. Los sistemas RAG se componen de tres componentes esenciales: un “buscador” que rastrea fuentes de datos externas utilizando incrustaciones semánticas, una capa de “augmentación” que conserva tanto el contenido original como las representaciones vectorizadas, y un “generador” impulsado por un modelo de lenguaje grande (LLM) que produce respuestas fundadas y fácticas. Esto ahorra memoria ya que, en lugar de forzar a los modelos a memorizar bases de conocimiento completas, los sistemas RAG se centran únicamente en la información relevante. Imagina a un estudiante que prefiere estudiar material relevante para su examen en lugar de leer libros de texto completos y irrelevantes. Esto es particularmente valioso en dominios donde la precisión es crítica y la información cambia constantemente. Imagina que eres el propietario de una empresa de atención médica. Con RAG, puedes obtener respuestas confiables y actuales a preguntas como “¿Cuáles son los últimos avances en la terapia del cáncer de próstata?” o “¿Cuál es la eficacia de las diferentes vacunas COVID?”. Los sistemas RAG pueden buscar las respuestas en bases de conocimiento actualizadas y generar respuestas en lenguaje natural, brindándote información precisa cuando la necesitas. Esta poderosa herramienta también está alterando otros campos como el sector de atención al cliente, proporcionando respuestas conversacionales ricas en contexto en lugar de simples listas de enlaces. El potencial de la tecnología RAG va más allá del 2026. Se espera que para el 2027, exista una adopción generalizada de orquestación de agentes, con sistemas RAG multiagente en el 40% de las aplicaciones de IA empresarial. Además, las arquitecturas de aprendizaje continuo permitirán que los sistemas RAG mantengan un historial de interacción del usuario y personalicen la recuperación basada en comentarios. Piénsalo como hablar con un asistente personal que recuerda todas tus preferencias y solicitudes pasadas a la perfección. Concluyendo, pensemos en qué tan crucial es la adecuada gestión de la información en esta era de grandes datos. El sistema RAG se posiciona como un recurso indispensable y eficiente para las empresas que buscan construir sistemas de inteligencia artificial confiables para afrontar el futuro. Al final, la capacidad de un sistema de inteligencia artificial para recurrir a la información adecuada al momento de tomar decisiones puede impactar significativamente los resultados de negocios. ¿Estás listo para hacer esta transición?

Grok 3 vs. ChatGPT: lo que realmente los separa

¿Qué pasaría si tuvieras a tu disposición un asistente personal que podría digerir y analizar enormes volúmenes de información en tiempo real? ¿Y si este asistente pudiera también hacer un esfuerzo consciente para transparentar sus métodos de pensamiento y fuente de información? Bueno, tal vez no tengas que esperar mucho tiempo para conocerlo. Aquí es donde entra en juego Grok 3, la propuesta estrella de xAI en el mundo de la inteligencia artificial, que ha desatado un terremoto en la competencia con plataformas como ChatGPT. Lanzado en febrero de 2025, Grok 3 ha llegado al escenario de IA pisando fuerte. Potenciado por el centro de datos Colossus de xAI, y con una capacidad de procesamiento 10 veces mayor que su predecesor, Grok 3 se ha consolidado como una presencia formidable en un mercado dominado hasta ahora por modelos de OpenAI y Google como ChatGPT 5.2 y Gemini 3. Lo que distingue a Grok 3 es su enfoque en la transparencia y el acceso a la información en tiempo real. Cuenta con una ventana de contexto masiva que soporta hasta 1 millón de tokens, permitiéndole procesar bases de código completas o documentos legales largos en una sola interacción. Además, incluye DeepSearch, un motor de razonamiento transparente que visualiza su proceso de pensamiento y cita sus fuentes, proporcionando un nivel de transparencia y atribución de fuentes que es raro en el panorama de IA. Además, Grok 3 incorpora un “modo cerebro grande”, diseñado para análisis de datos complejos y resolución de problemas al nivel de doctorado. Y si eso no fuera suficiente, Grok 3 no se limita al análisis de texto. También puede incorporar análisis de imágenes y generación de contenido de alta fidelidad. Imagina que tienes una gran tienda en línea y quieres obtener una descripción detallada y en tiempo real del sentimiento de los clientes sobre tus productos. Aquí es donde Grok 3 realmente brilla. Gracias a su capacidad de acceder a la plataforma X (anteriormente Twitter) para obtener información actualizada al minuto sobre eventos globales, podrías obtener una visión en tiempo real del sentimiento del cliente y las tendencias del mercado. ¿O qué tal si eres un investigador y te enfrentas a un problema complejo que requiere el análisis de un volumen masivo de documentos e imágenes? Grok 3 podría ayudarte a simplificar esta tarea, procesando y analizando todos estos datos y proporcionándote un resumen claro y transparente de sus hallazgos. A pesar de su poder, Grok 3 no está exento de desafíos. Si bien ofrece capacidades agenticas que permiten planificar, escribir y probar código de manera autónoma, los análisis comparativos indican que las salidas de codificación de Grok suelen ser menos confiables y más propensas a errores que las de modelos de OpenAI o Anthropic. Sin embargo, su principal ventaja competitiva radica en la capacidad de acceso a información en tiempo real, un hecho que le permite tomar la delantera a otros modelos en el análisis de noticias y la cobertura de temas de tendencia. A medida que miramos hacia el futuro, podemos esperar a lo que vendrá con Grok 5, que se lanzará en el primer trimestre de 2026 con 6 billones de parámetros, el doble de la cantidad presente en los modelos Grok 3 y 4. Esto representa una expansión significativa dirigida a ofrecer una mayor “densidad de inteligencia por gigabyte”. Pero, ¿esto significará un paso adelante en la practicidad de la inteligencia artificial y la resolución de problemas en tiempo real? Solo el tiempo lo dirá. En Aithra, seguimos de cerca estos desarrollos, siempre buscando las mejores y más efectivas maneras de poner la IA a tu servicio.

Cómo GPT-5 simplifica flujos complejos con su enfoque todo-en-uno

En el corazón del universo digital, las transformaciones tecnológicas son dinámicas y a veces silenciosas, pero siempre decisivas. Hoy, podrías imaginar ¿qué sucedería si tu inteligencia artificial habitual pudiera razonar, procesar informaciones múltiples y realizar tareas específicas, todo en tiempo real? Esa es la promesa del modelo GPT-5 de OpenAI, la mayor innovación arquitectónica desde GPT-4, que unifica tecnologías en una sola interfaz. A partir del lanzamiento del 7 de agosto de 2025, GPT-5 ha anunciado una revolución en la forma en que las empresas abordan los sistemas de inteligencia artificial. El GPT-5 llega con un cambio significativo en cuanto a la accesibilidad y el rendimiento del modelo anterior. Donde antes los usuarios tenían que cambiar entre diferentes variantes como GPT-4 Turbo o o1, GPT-5 consolida todas las funcionalidades avanzadas en un solo sistema, logrando así la eliminación de las restricciones y creando atractivas oportunidades para quien desea optimizar sus flujos de trabajo con inteligencia artificial. ¿Qué nos traerá el GPT-5, exactamente? Veámoslo como un super asistente dispuesto a ahorrarle tiempo a cualquier tarea pesada. Uno de ellos es el sistema de encaminamiento dinámico, que selecciona automáticamente la trayectoria óptima de razonamiento para cada consulta, combinando rapidez con profundo razonamiento cognitivo en tiempo real. Además, ha duplicado su ventana de contexto a 256K tokens permitiendo la gestión de documentos mucho más largos y flujos de trabajo multi-paso. Imagínalo como un bibliotecario que además de almacenar libros en una biblioteca gigante, reconocer cada título y contenido simplemente con mirarlo. Además, GPT-5 trata sin problemas texto, voz, imagen y video en una única interfaz, eliminando la fricción en flujos de trabajo multi-formato que necesitaban caminos de procesamiento separados usando su funcionalidad multimodal. Imagina que tienes una empresa de marketing digital y tu equipo necesita procesar una gran cantidad de datos diarios. En lugar de cambiar entre múltiples herramientas para analizar y usar diferentes datos, puedes hacerlo en un solo lugar. El modelo también ha mostrado un aumento del 18% en la precisión factual y la fiabilidad en el razonamiento en comparación con GPT-4 Turbo. Ha introducido el acceso en tiempo real a la web con recuperación de la información comprobada, permitiendo su uso en casos que requieren datos de mercado actuales, información reguladora, o conocimiento sensible al tiempo. ¿Te imaginas estar trabajando en un negocio de comercio electrónico que debe tener una visión actualizada y consistente del mercado? Toda esta información podría recopilarse y analizarse en tiempo real, lo que permitiría decisiones de negocio informadas. OpenAI anunció también que se lanzarán mejoras durante todo el 2026 empezando por mejoras en el razonamiento de voz y visual. Además, se prevé que la investigación en GPT-6 comenzará a mediados de 2026. Incursionar en un nuevo modelo genera la pregunta ¿qué espera el futuro para GPT-5 y sus variantes? Hacer la pregunta es criar la posibilidad de un futuro donde las capacidades de GPT-5 de contexto y personalización continúen desarrollándose, brindando a las empresas una tecnología en IA mucho más cercana, personalizada y efectiva. Con esto en mente, podemos decir sin duda alguna que el GPT-5 no es solo una actualización, sino una verdadera revolución. Apunta a rediseñar la forma en que las empresas y los desarrolladores abordan la inteligencia artificial para las necesidades de negocios y personales. El GPT-5 se muestra menos como una opción y más como una necesidad para todos aquellos que buscan mantenerse al día con la era de la IA. Y al parecer, solo hemos arañado la superficie de lo que la tecnología GPT-5 puede lograr. Para aquellos interesados en saber más sobre cómo optimizar tus flujos de trabajo, pueden consultar el artículo sobre MCP: el nuevo traductor universal entre sistemas de IA y software.

Nano Banana Pro: imágenes perfectas con solo describirlas

¡Imagina poder generar imágenes de calidad profesional con la precisión de un virtuoso del design gráfico únicamente a traves de simples comandos de texto! Bueno, no tienes que imaginarlo: estás a punto de conocer el Nanobanana, la tecnología estrella de Inteligencia Artificial (IA) de Google, que ha hecho realidad esta impresionante posibilidad. Recientemente, Nano Banana Pro alcanzó un hito impresionante: generó más de mil millones de imágenes en apenas 53 días, un logro que refuerza su rápido surgimiento como plataforma líder en generación de imágenes. Este gigante tecnológico rompió las barreras de la creatividad de los usuarios cuando introdujo, en septiembre de 2025, esta tecnología que cambió las reglas del juego. El Nano Banana Pro, su versión más reciente, es una herramienta de producción de imágenes más potente y precisa que su hermano original. La tecnología Nanobanana surge de la evolución de dos modelos: Nano Banana y el más reciente, Nano Banana Pro, ambos apoyándose en las capacidades avanzadas de razonamiento de Google DeepMind para ofrecer singularidades que los distinguen en el mercado de la generación de imágenes de IA. Pensemos en sus capacidades como en los ojos y manos de un artista excepcional que jamás comete un error. El Nano Banana Pro ha logrado una precisión del 99% en la representación de texto en imágenes, una tarea históricamente difícil para los generadores de imágenes de IA. Esto significa que puedes generar imágenes con texto renderizado correctamente y legible en varios idiomas, facilitando su uso para aplicaciones profesionales como diapositivas de presentación, gráficos educativos y creación de contenido multilingüe. Además, el Nano Banana posee habilidades de razonamiento avanzadas y un vasto conocimiento del mundo, que permiten la generación de imágenes contextuales. Posee el poder de comprender la profundidad, la sutileza y las tareas de razonamiento visual complejas más allá del simple realismo fotográfico. ¿Puedes imaginar crear explicaciones educativas e infografías exactas con solo insertar una frase descriptiva? Este nivel de generación de imágenes cambia el panorama de la creación de contenido. Imagina que eres un corredor de propiedades. Con la gran cantidad de anuncios en línea, necesitas que tus listados destaquen. Aquí es donde entra el Nano Banana. Con su capacidad para crear imágenes detalladas y bellamente renderizadas basándose únicamente en descripciones textuales, ahora puedes generar visualizaciones realistas de cada propiedad en tu portafolio, ayudándote a captar la atención de los compradores potenciales. No tienes que ser un fotógrafo experto para hacerlo; sólo necesitas escribir palabras. Además, si eres toda una empresa y necesitas presentar nuevos productos o hacer publicidad, Google también ha actualizado la generación de imágenes en Google Ads y ha puesto a disposición de los clientes de Workspace el Nano Banana Pro. Este software también funciona para esas labores; desde listar productos hasta diseñar catálogos o maquetar UI/UX, estas posibilidades también podrían ser clave para las empresas. Al mantener una mirada proactiva hacia el futuro, es probable que veamos cada vez más la brillantez de Nano Banana emerger en más plataformas y aplicaciones. Sin embargo, a medida que la IA se arraiga más profundamente en nuestros sistemas productivos y creativos, la pregunta que queda en el aire es: ¿cómo cambian estas innovaciones nuestra relación con la creatividad y nuestra valoración del trabajo artístico? Lejos de ser una amenaza, las herramientas como el Nano Banana podrían ser la llave que nos abre a nuevas formas de expresión y creación nunca antes imaginadas.

Cómo Devin AI está facilitando el desarrollo de software para todos

¿Te imaginas un compañero de equipo en tu empresa de software que nunca se cansa, trabaja sin cesar y sigue mejorando su rendimiento? No, no estamos hablando de una fantasía futurista, sino de una realidad presente en el mundo tecnológico. Un nuevo paradigma ha llegado a la industria del desarrollo de software, y su nombre es Devin AI. Nos encontramos en una época donde la tecnología es una constante carrera contra el tiempo, con actualizaciones y mejoras diarias. El pasado mes de septiembre de 2025 fue crucial para Devin AI. La empresa detrás de la tecnología, Cognition AI, lanzó una nueva vista previa del agente impulsada por Claude Sonnet 4.5, mejorando el rendimiento en un 100% y mejorando los resultados en pruebas de nivel junior en un 12%. Esta evolución significó una gran salto tecnológico, consiguiendo que las mismas tareas requirieran menos Unidades de Computación de AI (ACU, por sus siglas en inglés), reduciendo a la vez los costos operativos. El Devin AI es como un compositor que no solo toca la música sino que también la crea. Trabaja en tareas de codificación, desde depuración hasta la construcción de funciones. Comprende patrones dentro de vastos códigos y mejora la calidad de las solicitudes de extracción. En un amplio sistema de código fuente, Devin ahora identifica los archivos relevantes con una precisión asombrosa. Pero no todo es establecer relaciones entre el código, también se han añadido mejoras para facilitar la vida del desarrollador: persistencia de cookies de sesión para pruebas autenticadas, comandos de voz a través de la integración con Slack, y soporte optimizado para Docker con opciones de infraestructura “Large Performant”. Además, la reciente actualización de enero de 2025 introdujo entre sus novedades la posibilidad de superar la asignación mensual de ACU del equipo sin límites rígidos, introduciendo un sistema de facturación ‘pay-as-you-go’. Un cambio que permite ahora a las empresas pagar sólo cuando el gasto excede los $2,000 o al final del ciclo de facturación. Puede que viéndolo en acción te facilite la comprensión. Imagina que tienes una startup de software centrada en el desarrollo de aplicaciones móviles. Tu equipo está sobrecargado con tareas, pero contratar a más empleados es costoso. Sin embargo, con la ayuda de Devin AI puedes dar un gran paso adelante. Devin AI probando y depurando tu código, permitiendo al equipo centrarse en las tareas más importantes y liberando tiempo para la creatividad y la innovación. Devin no sólo está dirigido a grandes corporaciones con presupuestos gigantes. Al pasar de un modelo de empresa de $500 mensuales a $20 mensuales por pago según uso para desarrolladores individuales, Devin AI es ahora más accesible para pequeñas empresas y desarrolladores independientes. La tecnología de Devin abre un mundo de posibilidades para las empresas de todos los tamaños. El impacto de Devin AI en la industria del software es notable. Está aumentando sus dominios y ya se está utilizando incluso en empresas de servicios digitales líderes a nivel mundial como Infosys. Pero, a pesar de poder manejar el trabajo al nivel de un desarrollador junior, la función de Devin es más como un ‘primer respondedor’: está ahí para mejorar la eficiencia y reducir los costos, no para reemplazar a los humanos. Sin embargo, la pregunta sigue en el aire: ¿Hasta dónde llegará Devin AI? ¿Llegará el día en que los humanos sean innecesarios en el campo de desarrollo de software? Como en la música, pueden venir las máquinas a tocar la melodía, pero siempre se necesitarán los humanos para bailarla.

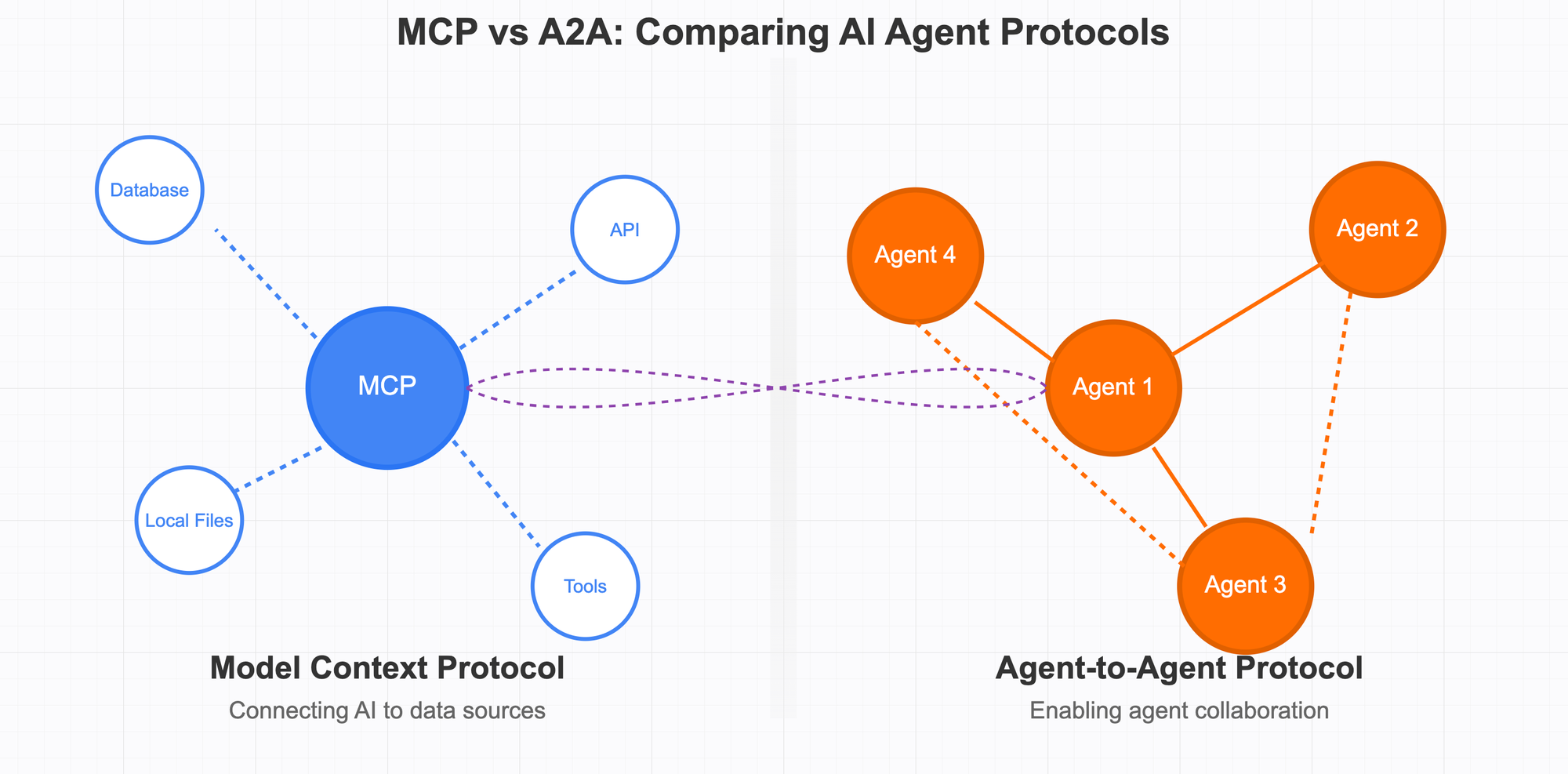

MCP: el nuevo traductor universal entre sistemas de IA y software

¿Te has preguntado qué pasaría si todos tus sistemas empresariales pudieran hablar un lenguaje universal, facilitando una comunicación fluida entre el software basado en IA? Esa visión que parece sacada de una película de ciencia ficción es ahora una realidad con el Protocolo de Contexto de Modelo (MCP por sus siglas en inglés). En noviembre de 2024, Anthropic presentó el MCP, una solución innovadora que está rediseñando la forma en la que los sistemas de IA se conectan a herramientas y fuentes de datos externas. Al establecer una interfaz universal para la comunicación de sistema a IA, el MCP resuelve un desafío crucial en la implementación de IA – permitiendo que los agentes autónomos operen en ecosistemas empresariales fragmentados sin requerir un código de integración personalizado para cada herramienta. El MCP es el “adaptador universal” del espacio de la IA. Al igual que el USB-C estandariza la conectividad de los dispositivos, MCP estandariza la comunicación entre las aplicaciones de IA y los servicios externos. Imagina que en lugar de construir integraciones separadas para cada API o base de datos, tuvieras un solo protocolo estandarizado que permitiera a los Modelos de Lenguaje Grande (LMGs) invocar funciones, buscar datos y utilizar solicitudes predefinidas de manera estructurada y segura. Este protocolo funciona a través de una arquitectura cliente-servidor; las aplicaciones alimentadas por IA (chatbots, asistententes de IDE, agentes) actúan como clientes de MCP, mientras que las integraciones externas funcionan como servidores de MCP que exponen sus capacidades sobre el protocolo. Así se garantiza que los modelos de IA no realicen llamadas a las API directamente; en su lugar, interactúan mediante un “apretón de manos” estructurado de MCP que valida y gestiona cada intercambio. Imagina que tienes un agente de IA sofisticado en tu empresa. Gracias al MCP, ahora puede recopilar datos de tu sistema de CRM, enviar comunicaciones a través de Slack o servicios de correo electrónico y registrar información en una base de datos, todo en un flujo de trabajo continuo. Y lo mejor es que no necesita entender la API única de cada sistema. ¿El resultado? Un cruce de comunicación sin fisuras y eficiente que reduce significativamente los cuellos de botella operativos. El MCP también extiende la interoperabilidad a las capacidades de participación del ser humano en el proceso, es decir, un agente de IA puede obtener datos adicionales del usuario y esperar a la aprobación de este antes de tomar alguna acción. Por lo tanto, no solo mejora la productividad, sino que también mantiene la toma de decisiones humanas en el corazón de los procesos automatizados. La llegada del MCP representa un cambio crucial en la forma en que la industria de la IA aborda la integración de sistemas, dejando atrás los conectores a medida para dar paso a sistemas de IA componibles e interoperables que pueden aprovechar de manera inteligente los datos y las herramientas empresariales a gran escala. ¿Podría el MCP ser el catalizador para la próxima ola de automatización empresarial y transformación digital? Solo el tiempo lo dirá, pero lo que es innegable es que ha abierto las puertas a un sinfín de posibilidades en lo que respecta a la interoperabilidad de los agentes de IA. Sin lugar a dudas, es un momento emocionante para ser parte de la evolución de la IA.