¿Qué pasaría si tuvieras un asistente las 24 horas del día para acelerar tu proceso de desarrollo de software, un guardián de código que pudiera detectar errores, proponer soluciones y hasta generar código por ti? Pues eso es precisamente lo que Cursor AI promete. No estamos hablando de una mera herramienta de análisis de código, sino de una revolucionaria experiencia de desarrollo con funcionalidad de IA integrada a su núcleo, que está cambiando para siempre la forma en que los desarrolladores trabajan. Tiene sentido hablar de esto ahora, porque Cursor ha lanzado recientemente una serie de avances importantes que lo posicionan como líder en la codificación aumentada por IA. En 2026, presentaron una interfaz rediseñada con su primer modelo de codificación exclusivo, mejorado mediante el aprendizaje por refuerzo para predecir con precisión lo que el usuario necesita. Y no se queda solo en eso, fue capaz de demostrar la creación de un navegador web completo en una semana, generando más de un millón de líneas de código usando billones de tokens en un impecable despliegue de planificación a largo plazo para proyectos de la vida real. Piensa en Cursor AI como un asistente incansable que, además de no necesitar café para funcionar, realmente comprende la esencia del código de tu proyecto. Analiza y comprende tu código para sugerir opciones de autocompletado inteligente, empareja patrones de la base de código en su totalidad y propone ediciones en todos los archivos involucrados. También es capaz de explicar los errores, modernizar el código antiguo, responder preguntas en lenguaje sencillo e inclusive traducir entre lenguajes de programación como Python y JavaScript. Por si fuera poco, también cuenta con un agente adicional, el Bugbot, un asistente especializado en realizar revisiones y corregir fallos en tu código automáticamente, detectando incluso problemas lógicos y de seguridad. Imagina que eres el CTO de una start-up de tecnología cuyo equipo de desarrollo se encuentra trabajando en una nueva aplicación web. En lugar de tener que lidiar con largas horas de revisión de código y depuración, solo necesitas recurrir a Cursor AI. Tu asistente de IA genera automáticamente las funciones o incluso la aplicación completa desde simples comentarios, liberando a tus desarrolladores de tareas rutinarias y permitiéndoles centrarse en tareas de arquitectura más pandas. En lugar de tener que luchar con errores y conflictos en el código, puedes tener a Bugbot limpiando y revisando tu código en tiempo real. Ahora imagina que tienes que desarrollar una nueva función para tu aplicación. En lugar de confiar en la memoria o buscar en las bibliotecas de códigos, simplemente le pides a Cursor AI que genere la función. Y como Cursor AI tiene una profunda conciencia de tu base de código, compete automáticamente con eficacia, integra las APIs necesarias y evita cualquier conflicto de dependencia antes de que ocurran. ¿No es eso ahorro de tiempo y esfuerzo? Y el futuro luce brillante para esta revolucionaria herramienta. Con un potencial cada vez mayor para la automatización y la generación de código, Cursor AI está dejando su marca en el ecosistema de tecnología. ¿Podrá en un futuro cercano el desarrollo de software ser completamente manejado por la inteligencia artificial, liberando por completo a los humanos del trabajo de codificación? Lo que es seguro es que estamos presenciando una verdadera revolución y que aquellos que se suban a esta ola de inteligencia artificial tendrán la ventaja. Como siempre, en Aithra nos mantenemos a la vanguardia, listos para ayudarte a implementar estas innovadoras soluciones de IA.

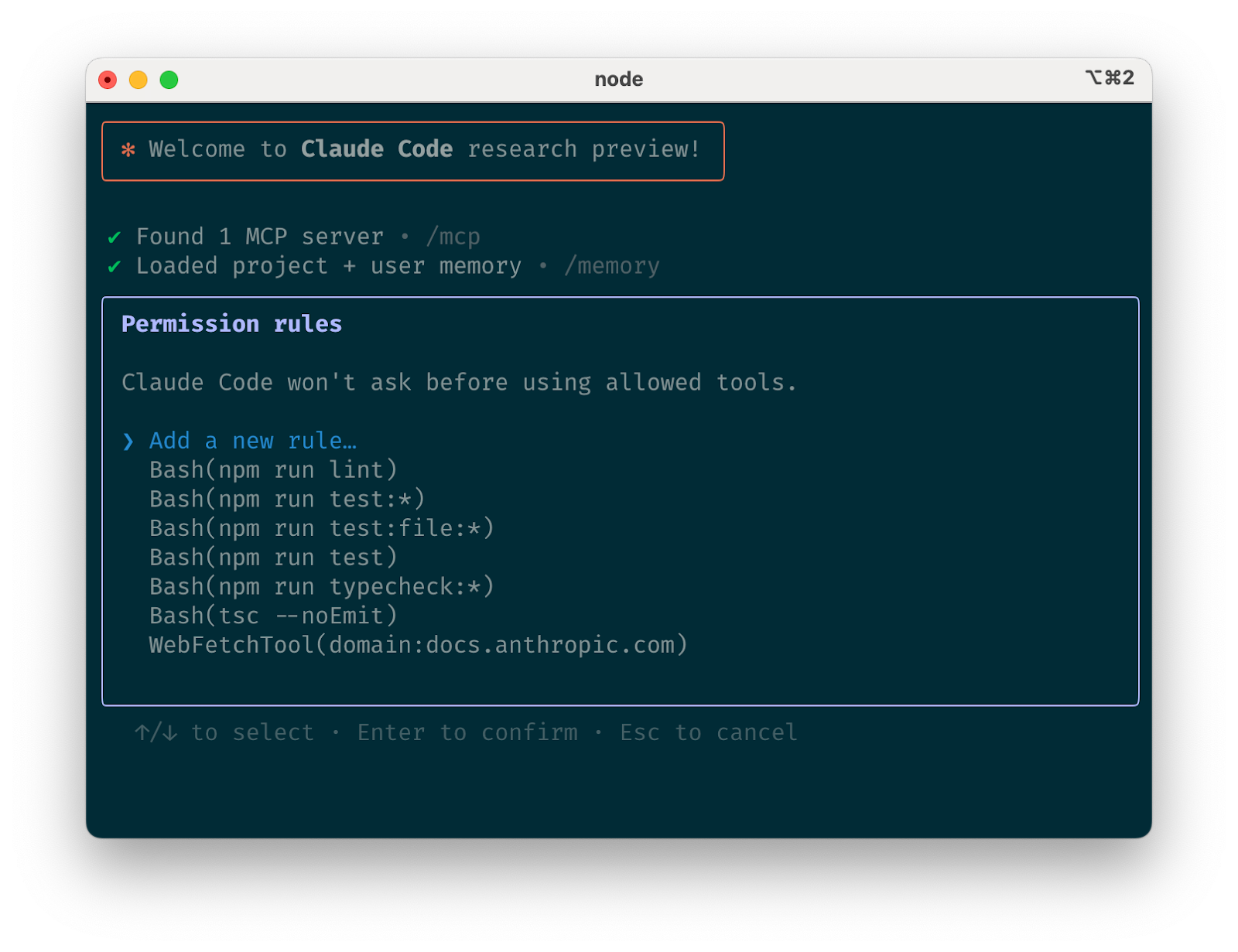

Claude Code simplifica la programación compleja como nunca antes

¿Te imaginas poder convertir tus ideas en código funcional en minutos en lugar de horas? Bienvenido al mundo de “Claude Code”, la herramienta que está revolucionando la programación asistida por inteligencia artificial. En la siempre cambiante tecnología, Anthropic lanzó una nueva herramienta a principios de 2026 que ha estado en boca de todos. Se llama “Claude Code” y representa un avance significativo en la programación asistida por IA. Con su última versión, Claude Opus 4.5, los modelos de IA pueden ejecutar considerablemente más trabajo de forma autónoma y corregir errores de programación con una fiabilidad superior a cualquier otra herramienta en el mercado. Comenzaremos con una analogía simple para entender qué hace a “Claude Code” tan especial. Imagina que tienes un asistente que nunca duerme, siempre recuerda, y puede ejecutar tareas complejas mientras mantiene la coherencia contextual. De esta manera, “Claude Code” es como este asistente sobrenatural para trabajos de desarrollo. Los modelos de IA de la herramienta tienen una comprensión de la intención notablemente mejorada y mantienen un contexto consistente durante sesiones prolongadas. Por tanto, pueden realizar cambios de código complejos en varios archivos. Además, “Claude Code” ha simplificado enormemente el proceso de desarrollo al incluir características nativas que antes requerían marcos y configuraciones personalizadas. Todo lo que inicialmente rodeaba a “Claude Code”, desde el ecosistema de marcos hasta las reglas personalizadas, se ha vuelto mayormente obsoleto. La versión moderna maneja trabajos de desarrollo con configuraciones de vainilla, y cuenta con herramientas integradas como la capacidad de “Hacer Preguntas al Usuario” y el modo de planificación que agilizan el proceso de desarrollo sin necesidad de andamios externos. Imagina que eres el dueño de un negocio de software y tienes que desarrollar un protocolo para un cliente en un plazo corto. Con la ayuda de “Claude Code”, puedes convertir tus ideas en código funcional en cuestión de minutos, y no horas como se hacía tradicionalmente. Y eso no es todo, con las habilidades especializadas del Agente -como la selección de problemas científicos, apoyo de bioinformática y generación de protocolos de ensayos clínicos-, los desarrolladores pueden ejecutar tareas técnicas complejas con facilidad. Organizaciones de atención médica como Carta Healthcare están utilizando modelos desarrollados con “Claude Code” para automatizar la abstracción de datos clínicos y la revisión de gráficos, reduciendo significativamente el esfuerzo administrativo manual y los cronogramas de implementación. Y no solo eso, las empresas de biotecnología como Schrödinger están aprovechando “Claude Code” como un “acelerador potente”, acelerando notablemente los ciclos de desarrollo de proyectos. Para una comprensión más profunda sobre las diferencias en el campo de la IA, consulta nuestra [guía esencial sobre AWS Agent Core para principiantes](https://aithra-studio.com/aws-agente-nucleo/). Se predice que “Claude Code” ampliará aún más sus capacidades en el futuro, especialmente en campos tan variados como la atención médica y la biotecnología. Con su adopción generalizada y la eficiencia comprobada, ¿Podría esta herramienta de Anthropic ser el catalizador que finalmente lleve al desarrollo de software a su próxima era de autonomía total? Además, para un análisis más específico de la automatización y el uso de IA en los negocios, puedes leer sobre [la revolución de la IA agencial y su impacto en las empresas](https://aithra-studio.com/la-revolucion-de-la-ia-agencial-y-su-impacto-en-las-empresas/). También es interesante ver cómo se compara con el uso de [navegadores alimentados por IA](https://aithra-studio.com/open-ai-atlas-exploracion-tecnologia/) que están revolucionando la forma en que interactuamos con la web y cómo se relaciona con [el panorama de la automatización empresarial](https://aithra-studio.com/agentes-de-ia-revolucion-automatizacion-empresarial/). Por último, para perspectivas sobre el futuro de la inteligencia artificial y su creciente papel en la transformación digital, un vistazo a las [tendencias clave de inteligencia artificial y LLMs que marcarán 2025](https://aithra-studio.com/tendencias-clave-inteligencia-artificial-llms-marcaran-2025/) ofrecerá una valiosa información.

Claude 4.5: La IA que redefine la automatización empresarial en 2026

Claude ha emergido como un importante desafiante al ChatGPT de OpenAI, con desarrollos recientes que lo posicionan como la opción preferida para la adopción de IA en empresas y tareas automatizadas de codificación en 2026. En noviembre de 2025, Claude Opus 4.5 debutó como el modelo de vanguardia más poderoso de Anthropic, avanzando significativamente las capacidades de la plataforma. La versión introdujo varias características críticas. Claude Cowork, lanzado como previsualización investigativa para usuarios de macOS en Claude Max, representa un cambio fundamental en los paradigmas de interacción con la IA. A diferencia de los competidores centrados en la nube, Cowork opera como un agente local con acceso directo a los sistemas de archivos del usuario, permitiendo a Claude leer, editar y crear archivos dentro de carpetas designadas sin tener que subir datos a servidores remotos. Esto aborda las crecientes preocupaciones sobre la privacidad y permite una IA agentica capaz de funcionar en modo offline. Además, se lanzó el Modo de Pensamiento Extendido, ahora exclusivo para niveles de pago, permitiendo a Claude 4.5 pausar y razonar a través de varias etapas lógicas antes de responder; una capacidad crítica para depurar bases de código complejas e identificar casos límite antes de generar código. Por otro lado, Claude Code recibió acceso ampliado, convirtiéndose en estándar para los asientos del plan de equipo a partir del 16 de enero de 2026, democratizando las capacidades de codificación avanzadas en todos los niveles organizativos. Claude mantiene una ligera ventaja en los benchmarks de codificación, logrando 77.2% en las puntuaciones verificadas de SWE-bench en comparación con el 74.1% de los competidores, convirtiéndolo en el preferido para la codificación agentication y el uso de computadoras basadas en el navegador. Además, su habilidad superior para navegar por interfaces de usuario complejas y procesar la entrada de la pantalla le otorga ventajas particulares en tareas de automatización y adquisición. El Claude Agent SDK ahora permite a las organizaciones construir subagentes personalizados que manejen roles especializados, como auditores de conformidad o revisores de código, con mayor persistencia y consistencia que los modelos de chat estándar. Sus nuevas capacidades de orquestación de agentes permiten a las empresas desplegar un Agente Líder que descompone proyectos masivos en tareas más pequeñas, delegándolas a subagentes especializados en codificación, pruebas y documentación. Los planes Empresariales y de Equipo incluyen el SCRIM (Sistema para la Gestión de Identidades en Varios Dominios) y registros de auditoría, abordando los estrictos requerimientos de gobernanza de datos en finanzas y salud. Evidentemente, el escenario competitivo ha cambiado notablemente; el capital de riesgo y la inversión corporativa favorecen cada vez más a Claude sobre ChatGPT, lo que sugiere un reconocimiento institucional de sus ventajas técnicas y su preparación para empresas. La arquitectura de Claude prioriza las capacidades de agente autónomo y el procesamiento local en primer lugar, posicionándola como la plataforma preferida para las organizaciones que integran la automatización dirigida por la IA en sus flujos de trabajo centrales.

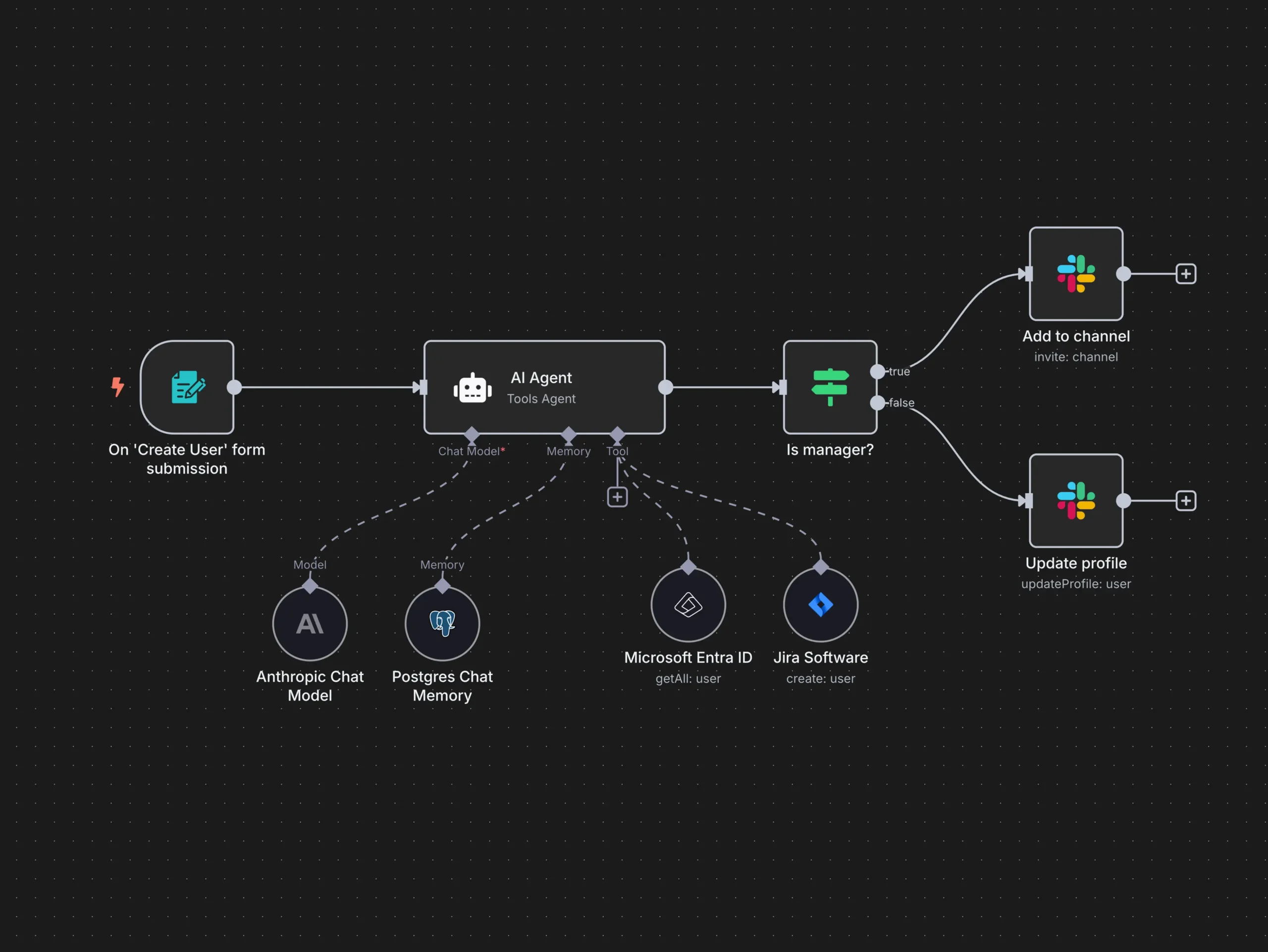

n8n 2.0 Revoluciona la Automatización con Inteligencia Artificial y Seguridad

Cuando pensamos en automatización y orquestación de IA, una plataforma cobra protagonismo: n8n 2.0. Lanzada recientemente, esta versión promete potenciar la seguridad y rendimiento, al tiempo que mejora la experiencia de usuario y permite la creación de flujos de trabajo asistidos por inteligencia artificial. La nueva versión de n8n, la 2.0, presenta cambios estructurales significativos, diseñados para reforzar la seguridad y estabilidad de la plataforma. Ahora, todas las ejecuciones del nodo de Código se realizan en entornos aislados, limitando el alcance de fallas en el caso de utilizar códigos no confiables o generados por IA. Además, la versión incluye el bloqueo de acceso de nodos de código a las variables de entorno, impidiendo la fuga accidental de secretos o claves API. De esta forma, n8n 2.0 se consolida como una herramienta segura y confiable para la automatización de flujos de trabajo. Sin embargo, esta versión no solamente se preocupa por la seguridad. n8n 2.0 también pretende mejorar la usabilidad, introduciendo cambios visuales en su lienzo y actualizaciones en su barra lateral, promoviendo una experiencia más intuitiva para la construcción de flujos de trabajo automatizados. Lo que hace especial a n8n 2.0 es su compromiso con la Inteligencia Artificial. A pesar de ser una versión de “endurecimiento” y no de “características”, se basa en una propuesta sólidamente enfocada a IA. Este enfoque permite a n8n asumir el papel de una solución para la automatización de flujos de trabajo y la orquestación de IA, algo que lo convierte en el “Estudio de IA n8n 2.0”. Este estudio de IA se concreta gracias a la combinación entre una interfaz visual intuitiva para el diseño de flujos basados en nodos, decenas de nodos de IA (como LLMs, embeddings, bases de datos vectoriales, procesamiento de lenguaje natural, OCR y procesamiento de imágenes) que funcionan como bloques de construcción plug-and-play, nodos de código en correderas de tareas aisladas que permiten lógicas y herramientas de agente personalizadas sin comprometer la seguridad, y más de 500 integraciones para conectar la IA con aplicaciones SaaS, sistemas internos y fuentes de datos. Estos avances son especialmente relevantes en un momento en el que las empresas buscan experimentar con agentes de IA y necesitan plataformas que puedan orquestar su uso de herramientas (APIs, bases de datos, aplicaciones SaaS), gestionar su estado, retrases y manejo de errores, y ejecutar políticas de seguridad y cumplimiento. Pero, adicionalmente a estas caracteristicas técnicas, es importante considerar el impacto de n8n 2.0 en la industria. n8n 2.0 se aleja de su percepción como una herramienta para aficionados y se postula como una solución de nivel empresarial, respondiendo a las preocupaciones de seguridad que muchas empresas tienen en torno a las herramientas de inteligencia artificial de código no propietario. Además, la fuerte apuesta por la auto hospedabilidad y el código abierto de n8n lo convierten en una opción atractiva para industrias sensibles a la privacidad y los equipos de plataformas internas. En resumen, n8n 2.0 no es solo una actualización más. Es una transformación que pone a la IA y a la seguridad como protagonistas, y va más allá de ser simplemente otra herramienta de no‑código. Representa la transición de la automatización basada en IA de la experimentación rápida a la orquestación unificada, y finalmente a la infraestructura de producción.

Agentes de IA: la tendencia tecnológica clave para el 2025

Los agentes de IA están surgiendo como una de las principales tendencias tecnológicas de IA para el 2025, cambiando la conversación de los “chatbots” a sistemas orientados a metas, que utilizan herramientas y pueden planificar, actuar y automatizar flujos de trabajo reales en entornos de software y TI. En este sentido, desde plataformas en la nube hasta marcos de trabajo y modelos fundamentales, el 2025 se perfila como el año en el que la “IA agente” se convierte en una categoría de producto de primera línea. Entre las actualizaciones más relevantes se encuentran las de OpenAI, que con la API Responses y el SDK Agentes, permite a los agentes planificar pasos e invocar herramientas de forma determinista. También destaca Operator, una herramienta que ilustra el uso de ordenadores en los que un agente de IA puede operar una interfaz, ejecutar flujos de trabajo de la interfaz y completar tareas de un extremo a otro, como navegar por las aplicaciones y rellenar formularios. Este conjunto está explícitamente diseñado para construir agentes en busca de metas, no solo interfaces de chat. Por otro lado, Amazon Bedrock Agents organiza acciones multietapa en sistemas empresariales y bases de conocimientos, permitiendo flujos de trabajo de extremo a extremo como soporte, análisis y campañas utilizando LLMs junto con herramientas y datos de la empresa. Los agentes pueden encadenar tareas como recuperar datos de CRMs/ERPs, transformarlo y desencadenar acciones posteriores. Por su parte, Vertex AI Agent Builder y Agent Engine de Google Cloud ofrecen una forma gestionada de conectar herramientas, APIs y tuberías RAG, y luego desplegar agentes en cargas de trabajo de producción. Google posiciona estas soluciones como un puente de las “aplicaciones de chat” a los agentes de software integrados en procesos de negocio. En cuanto a Anthropic, han adoptado el Modelo de Protocolo de Contexto (MCP) como un estándar abierto para conectar agentes de manera segura a fuentes de datos empresariales y herramientas (bases de datos, APIs, sistemas SaaS). Este estándar permite a los agentes acceder a herramientas y contexto, lo cual es crucial para escalar configuraciones de múltiples herramientas y agentes. Gartner, por su parte, ha nombrado a la IA Agente como la #1 Tendencia Tecnológica Estratégica para el 2025, definida como una IA que puede planificar, actuar y aprender con un alto grado de autonomía y no solo responder. Los agentes de IA, a diferencia de los tradicionales chatbots, son sistemas que pueden perseguir metas de forma autónoma, planificar flujos de trabajo multietapa, llamar a herramientas/APIs e interactuar con software, coordinarse con otros agentes y mantener a los humanos en el lazo para supervisión y aprobaciones. Esta transición, de “asistente que habla” a “entidad de software que realiza trabajo”, es lo que hace que los agentes de IA sean una tendencia central en el 2025. Las capacidades técnicas clave que impulsan esta tendencia incluyen la llamada a herramientas / funciones como un primitivo central, flujos de trabajo empresariales autónomos, colaboración entre múltiples agentes, personalización a través de RAG y avances a nivel de modelo que habilitan a los agentes. El impacto de los agentes de IA en la industria es significativo, remodelando cómo se construye el software y cómo se realizan las tareas digitales en distintos sectores. Se están convirtiendo en la esencia de la “tendencia tecnológica de IA para 2025”. Los agentes de IA en las tendencias tecnológicas de IA para el 2025 se sitúan en la intersección de varios temas macro: es una tendencia estratégica de primer nivel, los flujos de trabajo autónomos son el núcleo del valor empresarial, el cambio de la experimentación a la producción y una trayectoria a largo plazo. En conclusión, los agentes de IA están perfilándose como una de las principales tendencias para el 2025 y jugarán un papel cada vez más crucial en la transformación digital y en la manera en cómo se llevan a cabo los flujos de trabajo digitales.

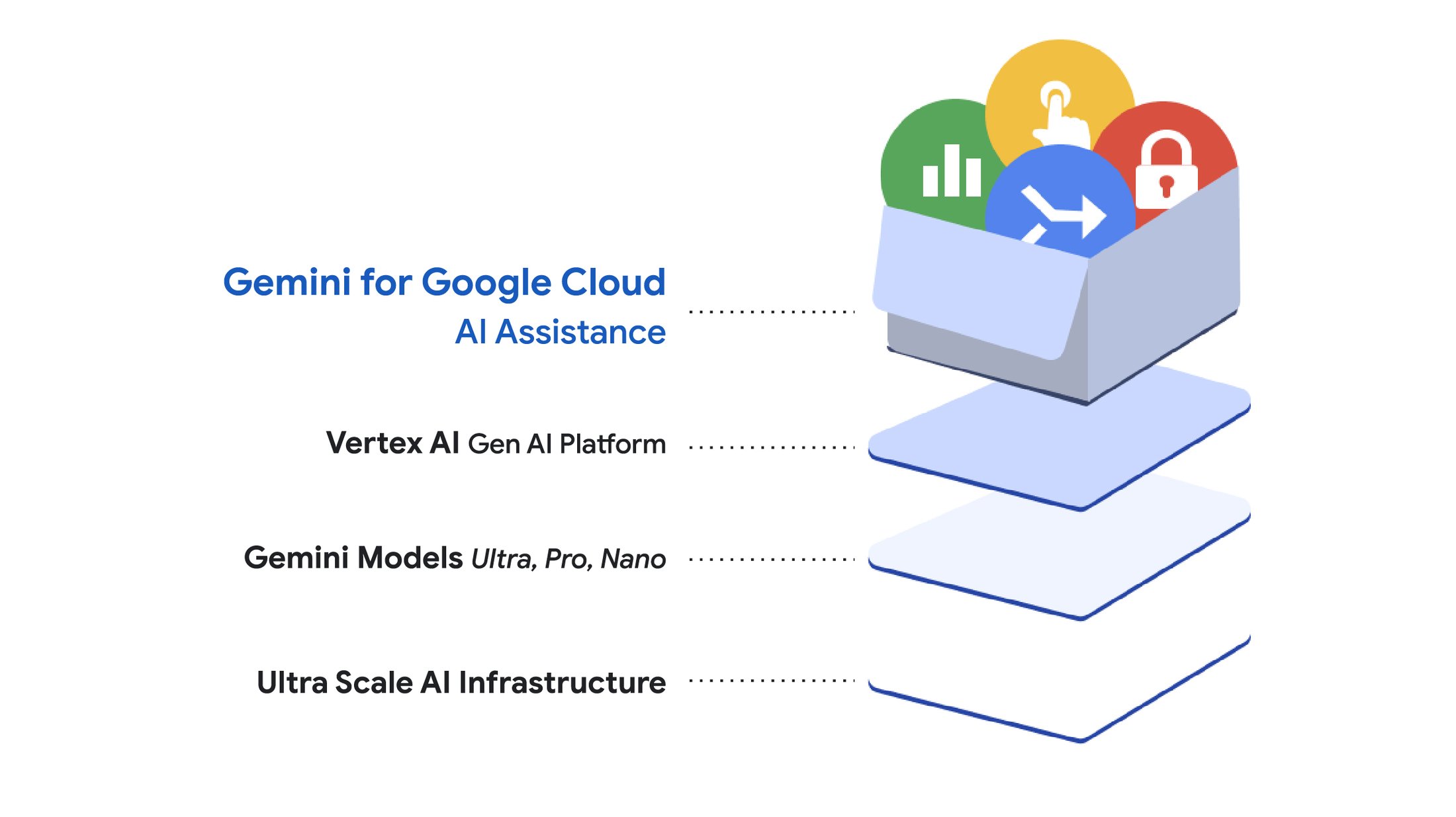

Gemini impulsando la revolución de la inteligencia artificial y la tecnología

Gemini: Impulsando las Nuevas Tendencias de IA y Transformando la Tecnología Bright, inteligente, y definitivamente disruptivo, Gemini está revolucionando la forma en que interactuamos con la tecnología. Producido por Google, Gemini ha cobrado protagonismo en las recientes tendencias de la inteligencia artificial, evolucionando de ser un simple modelo familiar a una plataforma integral capaz de abarcar desde modelos hasta aplicaciones, pasando por la búsqueda en la nube y los dispositivos. Gemini: Más Que Un Simple Chatbot El impacto de Gemini ha ido más allá de los clásicos chatbots y se ha convertido en el motor de razonamiento de la Búsqueda de Google y de la pila de productos de Google, lo que indica su importancia clave tanto en la experiencia de búsqueda como en el ecosistema publicitario. Según Google, y a modo de anécdota, “Gemini” fue el término de búsqueda global más utilizado en 2025, lo que refleja la gran curiosidad y la rápida adopción que ha tenido este modelo. Gemini: Un Aliado Para Los Desarrolladores Los desarrolladores de software han encontrado a Gemini como una herramienta de gran utilidad, especialmente para la generación de código y la refactorización a través de repositorios de múltiples archivos. Las funciones mejoradas de ejecución de código y búsqueda de herramientas de Gemini permiten soluciones más robustas e intervenciones humanas mínimas. De hecho, DeepMind reportó una mejora de más del 50% en el rendimiento de las herramientas de desarrollador con Gemini 3 Pro en comparación con Gemini 2.5 Pro. La Intersección de Gemini y Las Nuevas Tendencias de IA El avance tecnológico de Gemini se alinea directamente con varias tendencias emergentes en el campo de la inteligencia artificial: – Los modelos fundacionales se están convirtiendo en plataformas: Gemini ha evolucionado de ser un modelo a una plataforma completa, integrando modelos, APIs, aplicaciones, agentes, la Búsqueda de Google, Home, Workspace y herramientas de desarrollo. – AI agencial y orquestación de herramientas: Las funciones de ejecución de código y búsqueda de herramientas de Gemini, junto con las capacidades avanzadas de codificación agencial, son pasos concretos hacia agentes autónomos y de múltiples pasos. – Razonamiento de contexto grande y multimodal a gran escala: Los contextos de hasta 1M de tokens en Gemini 2.5 y los 2M de tokens en variantes anteriores de 1.5 Pro permiten cargar proyectos completos, repositorios o bases de conocimiento completas a la vez. – Confiabilidad, transparencia y gobernanza: Las capacidades de resumen y modo Deep Think de Gemini son respuestas explícitas a la demanda de razonamiento inspeccionable y una IA más segura en los flujos de trabajo empresariales. – La búsqueda y descubrimiento están siendo redefinidos por la IA: La integración de Gemini 3 en el modo AI de Búsqueda de Google es uno de los ejemplos más visibles de una empresa de motores de búsqueda que está cambiando su UX central en torno al razonamiento de LLM. Gemini: Facilitando la Inteligencia Artificial Para Todos El Gemini es más que una serie de impresionantes funciones y aplicaciones. Al final del día, representa una nueva era en la relación entre la inteligencia artificial y el usuario medio. A medida que Gemini continúa evolucionando e incorporándose en un número creciente de aplicaciones y dispositivos, se convierde en la cara de una nueva tendencia en la IA: una inteligencia artificial increíblemente avanzada pero accesible y fácil de usar. Así que, sin importar si eres un experto en tecnología o simplemente una persona que busca hacer su vida un poco más fácil, es muy probable que Gemini tenga algo que ofrecerte. Y, además, esto es solo el comienzo.

Agentes de IA: el futuro de la automatización y tecnología empresarial

Los agentes de IA se están convirtiendo en uno de los aspectos más relevantes de la IA generativa, evolucionando de simples chatbots a entidades de software semiautónomas que pueden tomar decisiones y completar flujos de trabajo en distintos sistemas digitales. Los agentes de IA combinan modelos de lenguaje amplios con la habilidad de planificar, usar herramientas y recordar para operar como trabajadores integrados en las plataformas tecnológicas ya existentes. Grandes proveedores de servicios en la nube y SaaS están convirtiendo sus plataformas de IA generativa en plataformas de agentes capaces de operar a través de aplicaciones y datos. Por ejemplo, los ecosistemas empresariales ahora cuentan con capas de orquestación donde un modelo de IA generativa principal coordina múltiples agentes especializados para ventas, soporte, análisis y operaciones de TI en un solo ambiente. Hablando en términos técnicos, un agente de IA es un proceso de software creado alrededor de un modelo generativo que puede observar un estado, planificar una secuencia de acciones, llamar a herramientas o servicios y actualizar su plan basado en los resultados obtenidos. Esta descripción lo diferencia significativamente de un asistente de IA generativa ya que un agente está diseñado para operar durante periodos de tiempo y en distintos sistemas, no solo en un intercambio de preguntas y respuestas. El auge de los agentes de IA representa un cambio significativo en la naturaleza misma de la IA generativa, pasando de ser una interfaz de usuario a una capa de ejecución capaz de mover datos y desencadenar acciones en toda la empresa. Para los equipos de software, esto significa convertirse en componentes programables que pueden ser responsables de flujos de trabajo completos, más que simplemente asistir a los humanos en cada paso. Las últimas generaciones de modelos de IA cuentan con entradas multimodales, ventanas de contexto más amplias y control de salidas estructuradas que son esenciales para la confiabilidad de los agentes en ambientes de software. La capacidad de llamar a funciones y utilizar APIs de herramientas permite que las salidas del modelo sean tratadas como comandos formales, facilitando la integración segura con bases de datos, CRM, herramientas de desarrollo y servicios internos. En diversos sectores, los agentes de IA están siendo implementados para mejorar los servicios al cliente, incrementar la productividad interna y optimizar procesos operativos. En el comercio digital y las aplicaciones para consumidores, los agentes de compras y recomendaciones investigan productos, comparan opciones y realizan compras en nombre de los usuarios, lo que plantea nuevas preguntas sobre seguridad, sesgo y control de la plataforma. La mejora continua en la IA generativa está difuminando la distinción entre asistentes y agentes, con muchas funciones de IA generativa dentro de los productos reconvertidas en flujos de trabajo agente detrás de las escenas. Para los equipos de software y tecnología, esto implica diseñar sistemas, APIs y gobernanzas con los agentes en mente, tratándolos como un nuevo tipo de trabajadores programables que deben ser monitorizados, auditados y segurizados igual que los usuarios humanos y los servicios tradicionales. Sin lugar a dudas, los agentes de IA están redefiniendo el futuro de la tecnología y la inteligencia artificial.

Perplexity y su crecimiento en la búsqueda por inteligencia artificial

Perplexity está emergiendo como un jugador destacable en el panorama de la búsqueda impulsada por inteligencia artificial (IA), por su enfoque en la recuperación de información en tiempo real y respuestas transparentes respecto a la fuente. La plataforma ha experimentado un crecimiento sustancial y continúa refinando sus capacidades a través de actualizaciones estratégicas. El camino de adopción de Perplexity muestra una aceleración notable dentro del sector de búsqueda por IA. La plataforma procesó 780 millones de consultas de búsqueda en mayo de 2025, lo que representa una triplicación del volumen desde los 230 millones de consultas a mediados de 2024. Este crecimiento subraya la adopción creciente por parte de los usuarios de alternativas de búsqueda impulsadas por la IA, especialmente entre profesionales y académicos que buscan una síntesis de datos en tiempo real, en lugar de los resultados de los motores de búsqueda tradicionales. Un importante diferenciador de Perplexity frente a otros modelos de lenguaje es su arquitectura centrada en la recopilación de datos en tiempo real y la citación transparente de las fuentes. A diferencia de ChatGPT, que depende de los cortes de datos de entrenamiento y modos de navegación opcionales, Perplexity primordialmente da preferencia a la recuperación de información actual, lo que lo hace particularmente efectivo para consultas que son sensibles al tiempo, en los ámbitos de noticias, finanzas, tecnología y ciencia. Las capacidades de procesamiento multimodal y la flexible selección de modelos son otras de las características distintivas de Perplexity. La plataforma admite texto, imágenes, PDFs y audio dentro de consultas unificadas. A diferencia de la dependencia exclusiva de ChatGPT en los modelos GPT de OpenAI, Perplexity ofrece una selección de modelos flexible, permitiendo a los usuarios elegir el modelo más adecuado para cada tarea. En los últimos meses, Perplexity ha realizado diversas actualizaciones. Una destacada es la integración de controles de privacidad a través del widget Snapshot, que proporciona alternancias de privacidad a nivel de sesión. Además, el asistente Comet de Perplexity ha sido mejorado para retener los hilos de chat activos cuando los usuarios abren fuentes vinculadas, lo cual ayuda a eliminar la necesidad de reiniciar conversaciones al cambiar de fuentes. A finales de noviembre de 2025, Perplexity lanzó asistentes de IA con capacidad de memoria que recuerda detalles clave de varias conversaciones y permite respuestas más contextuales y eficientes. Finalmente, Perplexity ha firmado un importante acuerdo de distribución con Snap Inc., integrando su motor de respuestas en Snapchat para un lanzamiento a principios de 2026. Dicho acuerdo le da a Perplexity acceso a casi mil millones de usuarios de Snapchat y posiciona el motor de búsqueda de IA dentro de un contexto de descubrimiento social destinado a mejorar el aprendizaje y el acceso a la información para las generaciones más jóvenes. A pesar de las mejoras funcionales y las métricas de crecimiento, el análisis de la industria ha señalado preguntas sobre la retención de usuarios y la posición competitiva a largo plazo. Estas preocupaciones reflejan las presiones estructurales más amplias dentro del panorama de la búsqueda por IA. Sin embargo, la estrategia de Perplexity de ampliar su área a través de asociaciones, servicios de datos en tiempo real y controles de privacidad aborda este entorno competitivo mediante la diferenciación en lugar de la escala. La evolución de la plataforma demuestra cómo las plataformas de búsqueda impulsadas por IA están pasando de ser herramientas de investigación a utilidades integradas que sirven para las necesidades cotidianas de información con transparencia, rapidez y datos actuales, posicionando a los motores de respuestas en tiempo real como una categoría distinta dentro del ecosistema de software de IA más amplio.

Revolución de ChatGPT: cómo GPT-5 redefine la inteligencia artificial en 2025

ChatGPT ha experimentado una transformación sustancial a lo largo de 2025, consolidándose como un actor central en el cambio de la industria de la inteligencia artificial hacia asistentes de IA más inteligentes, personalizados e integrados. La plataforma ahora sirve a 800 millones de usuarios y procesa 29,000 prompts por segundo, lo que la convierte en uno de los sistemas de IA más adoptados a nivel mundial. El desarrollo más significativo en 2025 ha sido el lanzamiento de GPT-5, que reinventa fundamentalmente cómo funciona ChatGPT como plataforma. En lugar de obligar a los usuarios a cambiar manualmente entre diferentes opciones de modelos (GPT-4o, o1 y otros), GPT-5 presenta un sistema inteligente de cambio automático que determina automáticamente cómo procesar cada consulta en función del contexto y la complejidad de la tarea. GPT-5 se está implementando en todos los niveles de usuarios de ChatGPT: Plus, Pro, Team y planes gratuitos, con planes Enterprise y Edu que recibirán acceso pronto. Esto representa un cambio significativo hacia una experiencia de IA unificada en lugar de una fragmentada. GPT-5 integra un conjunto completo de capacidades avanzadas diseñadas para manejar tareas cada vez más complejas: – Interacción avanzada de voz con calidad mejorada y latencia reducida – Búsqueda en web en tiempo real con una mayor factualidad y menos alucinaciones – Lona para el razonamiento espacial, lo que permite una mejor visualización y manipulación de información compleja – Funcionalidad de investigación profunda que va más allá del análisis superficial – Niveles de inteligencia estratificados, donde los usuarios de la versión gratuita acceden a la funcionalidad básica mientras que los suscriptores de pago desbloquean modos de mayor capacidad. Arquitectónicamente, GPT-5 introduce un procesamiento más rápido y un manejo de información más eficiente, lo que permite capacidades de razonamiento más profundas y una adaptación más intuitiva a una gama más amplia de tareas. OpenAI introdujo mejoras especializadas en GPT-5 Instant para reconocer y apoyar mejor a las personas que experimentan angustia emocional. El modelo ahora detecta más precisamente los signos de angustia mental y emocional y puede desconectar las conversaciones mientras dirige a los usuarios a recursos de crisis del mundo real. Una actualización de usabilidad importante hizo que los ajustes de personalidad y las instrucciones personalizadas se apliquen instantáneamente en todas las conversaciones de ChatGPT, incluyendo los hilos existentes. Anteriormente, los cambios de personalización solo afectaban los nuevos chats, creando una experiencia de usuario fragmentada. Este cambio garantiza un comportamiento de IA consistente a lo largo de toda la historia de conversación de un usuario. La presentación de la arquitectura unificada de GPT-5 representa una tendencia importante de la industria: la consolidación de varios modelos especializados en un solo sistema inteligente. En lugar de mantener modelos separados de razonamiento, respuesta rápida y propósito general, GPT-5 asigna automáticamente los recursos computacionales en función de las necesidades de la tarea. A lo largo de 2025, ChatGPT ha enfatizado cada vez más la personalización como una capacidad central. Desde las instrucciones personalizadas hasta el aprendizaje asincrónico de Pulse hasta las respuestas adaptativas, la plataforma trata la personalización no como una característica opcional, sino como fundamental para su propuesta de valor. La introducción de Instant Checkout en septiembre de 2025 demuestra que la integración de AI al comercio se está convirtiendo en central para el roadmap de ChatGPT. Al incorporar los flujos de compra directamente dentro de la interfaz de chat, OpenAI está posicionando a ChatGPT como una plataforma transaccional, no solo una herramienta de información. Las actualizaciones enfocadas en la salud mental a GPT-5 Instant ilustran cómo las plataformas de IA están incorporando mecanismos de seguridad conductual guiados por expertos en el campo. Esta tendencia señala que se espera que los sistemas modernos de IA incluyan barreras que se extiendan más allá del filtrado de contenido para incluir la conciencia emocional y la intervención en crisis. ChatGPT’s 2025 trajectory demonstrates that the competitive frontier in AI has shifted from raw capability improvements to usability, personalization, safety, and integrated functionality. As the platform matures with 800 million users, its innovations increasingly influence how the broader AI industry conceptualizes assistant design, user experience, and responsible deployment.

El papel transformador de los Modelos de Lenguaje Amplio en 2025

El panorama de los Modelos de Lenguaje Amplio (LLM) está cambiando de manera significativa en 2025. Lo que se percibía como una expansión en el terreno experimental de las capacidades de inteligencia artificial, está evolucionando hacia una adopción práctica, escalable y confiable en las empresas. Los LLM se están convirtiendo de herramientas experimentales a infraestructuras empresariales esenciales. Los LLM han experimentado una transformación en cuanto al costo y la eficiencia. El coste de generar una respuesta desde un modelo ha disminuido en un factor de 1.000 durante los últimos dos años, alineándolo con el costo de una búsqueda web básica. Esta reducción enorme en los costos operativos ha vuelto a la IA en tiempo real fundamentalmente más viable para las tareas empresariales rutinarias. En lugar de enfocarse solo en el tamaño, los modelos más destacados actualmente incluyen a Claude Sonnet 4, Gemini Flash 2.5, Grok 4 y DeepSeek V3. El diferenciador se ha convertido en si un modelo puede manejar una entrada compleja, soportar una integración sin problemas y ofrecer salidas confiables de manera constante. En 2025, una avanzada crucial ha sido la adopción del aprendizaje por refuerzo con recompensas verificables como una segunda vía para escalar la inteligencia. Esta estrategia resulta particularmente efectiva en entornos de codificación, donde es posible la verificación determinística, haciendo de la generación de código el primer verdadero caso de uso de la IA. La era de los LLM genéricos está llegando a su fin. Las organizaciones están desplegando cada vez más modelos personalizados para sectores específicos como el legal, el de la salud, el de la manufactura y el financiero. Esta especialización permite una mejora drástica en el rendimiento y la adhesión regulatoria en comparación con los enfoques generalistas. Los LLM están convergiendo hacia las verdaderas capacidades multimodales, combinando de manera fluida la comprensión del texto, las imágenes, el audio y el video en un solo modelo. Esto permite flujos de trabajo complejos donde un sistema de IA puede leer contratos, analizar gráficos e interpretar preguntas habladas. Los LLM también son cada vez más eficaces como asesores en lugar de simples generadores de respuestas. Ellos pueden entender interacciones previas, las políticas de la empresa y las preferencias del usuario. Los avances en la eficiencia del modelo también han hecho viable que las empresas puedan ejecutar poderosos LLM en servidores locales o dispositivos periféricos. El panorama empresarial está adoptando cada vez más la IA agencial, es decir, sistemas diseñados para tomar acciones autónomas en lugar de simplemente generar contenido. Los agentes modernos de IA piensan paso por paso, razonan a través de los problemas de forma iterativa y hacen uso de herramientas externas como la búsqueda, las calculadoras, los entornos de codificación y otros recursos. Se espera que los ecosistemas digitales deban construirse tanto para los agentes de IA como para los usuarios humanos en los próximos tres a cinco años. Las empresas están adoptando a la IA como un operador capaz de activar flujos de trabajo, interactuar con software y manejar tareas complejas con mínima intervención humana. No obstante, se han presentado desafíos como la disponibilidad de datos. La generación de modelos grandes históricamente ha dependido de la recolección de grandes cantidades de texto de internet, pero esa fuente se está agotando. En respuesta, los datos sintéticos han surgido como un recurso estratégico. En lugar de obtenerlos de la web, estos datos son generados por modelos para simular patrones realistas. En el ámbito empresarial, los LLM se están integrando estrechamente en los sistemas empresariales. Los interfaces de lenguaje natural permiten a los usuarios no técnicos obtener insights accionables instantáneamente. Además, los LLM están aportando valor tangible a través del soporte al cliente, la creación de contenido y el desarrollo de software. Sin embargo, la consolidación del mercado refleja una realidad más amplia de la industria: en 2025, las empresas priorizan el rendimiento probado y la confiabilidad de integración sobre la exploración de alternativas incipientes. Una de las características definitorias de 2025 es la aceleración del cambio en sí mismo. La pregunta crucial para los líderes empresariales es cómo seguir el ritmo de los avances rápidos en la IA y cómo aprovechar al máximo estos desarrollos para impulsar sus negocios. En este sentido, las organizaciones que invierten en mantenerse informadas sobre las capacidades emergentes y las estrategias de implementación mantendrán ventajas competitivas en un panorama empresarial cada vez más impulsado por la IA.